目录

一、引言:AI视频赛道的最强黑马

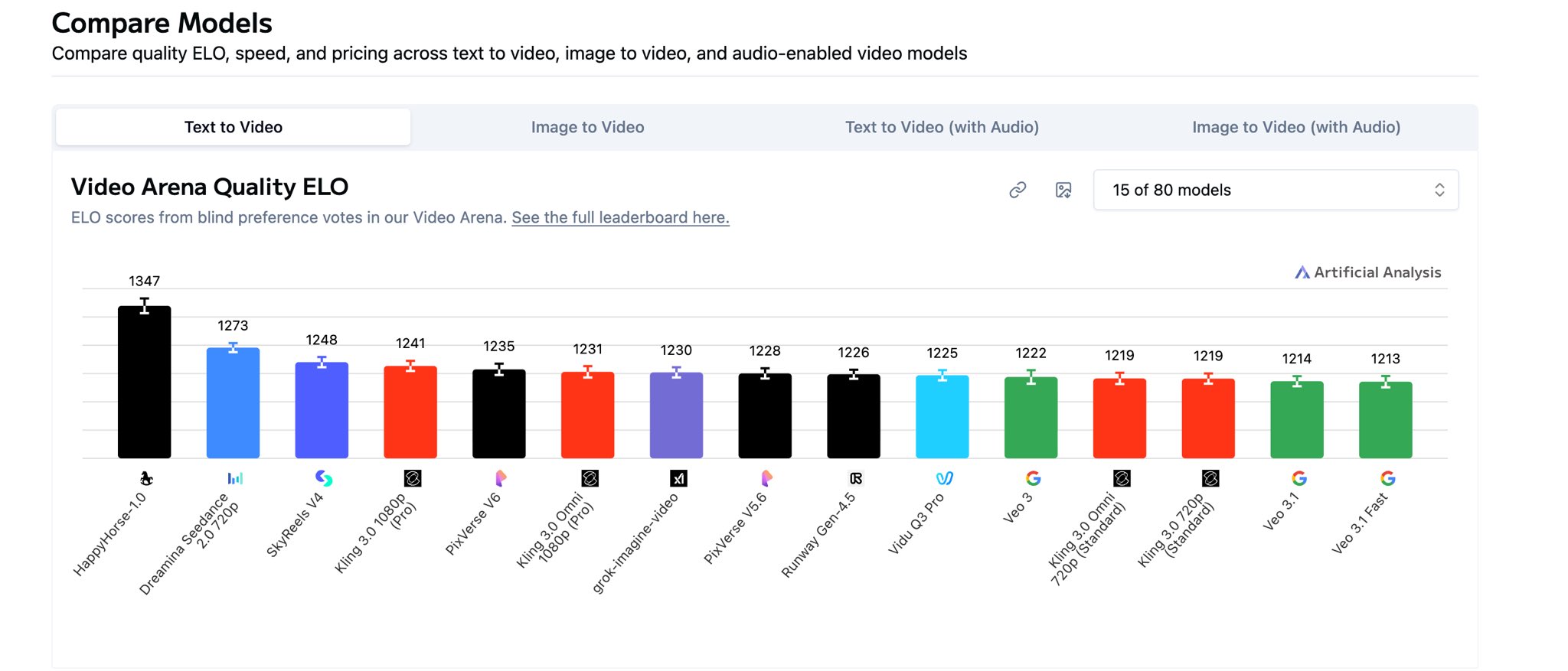

2026年,AI视频生成赛道堪称全球科技圈最卷的战场——字节跳动Seedance 2.0、Google Veo 3、OpenAI Sora 2、快手Kling 3.0,每隔几周就有巨头祭出新王炸。然而,4月7日凌晨,一款没有任何公司背书、没有技术博客、甚至连GitHub都不存在的神秘模型,在全球最权威的AI视频盲测榜单上,以碾压性的优势横扫所有玩家,登顶王座。

然后,它消失了。

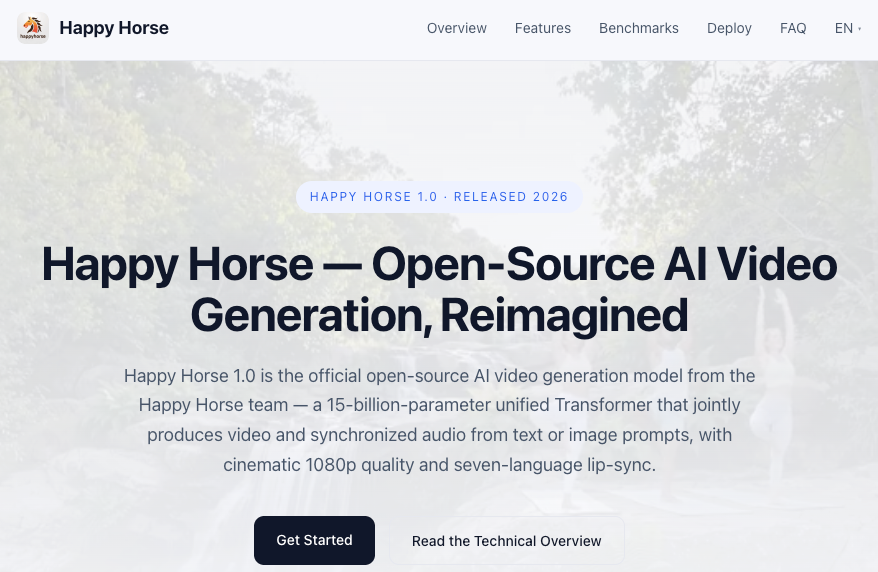

从空降到下架,前后不过72小时。这匹被称为"Happy Horse"(快乐马)的神秘AI视频生成模型,在没有任何官方说明的情况下,留下了满屏的技术圈震惊与无尽猜测。截至目前,没有一家公司站出来认领。

核心悬念:一款从未正式发布的产品,如何在72小时内让整个AI行业为之震动?它的幕后推手究竟是谁?它代表的技术路线,为什么让所有大厂都坐立不安?

演示 MP4 video to GIF:

二、全景速览:三分钟读懂Happy Horse事件

以下信息基于Artificial Analysis(全球AI视频权威评测平台)公开数据、第三方技术分析及多方媒体报道整理(截至2026年4月9日):

| 信息维度 | 详情 |

|---|---|

| 模型名称 | HappyHorse-1.0(含V2变体) |

| 登场时间 | 2026年4月7日凌晨(UTC) |

| 上榜平台 | Artificial Analysis Video Arena(AI视频盲测Elo排行榜) |

| 提交方式 | 匿名(pseudonymous),无公司/团队背书 |

| 消失时间 | 登顶后72小时内,从榜单上悄然撤下 |

| 模型架构 | 40层单流Self-Attention Transformer,约150亿参数 |

| 核心能力 | 文本/图像→视频+音频联合生成,支持6种语言唇形同步 |

| 生成速度 | H100 GPU,约38秒生成5秒1080p高清视频 |

| 推理优化 | 仅需8步去噪,无需CFG(无分类器自由引导) |

| 开源承诺 | 官方声称"Everything is open",GitHub/HuggingFace标注"Coming Soon" |

| 开发者身份 | 社区猜测集中于阿里/字节/新兴团队三方;据"Top华人科创社"披露为淘天集团未来生活实验室(信息未经独立证实,原文已删) |

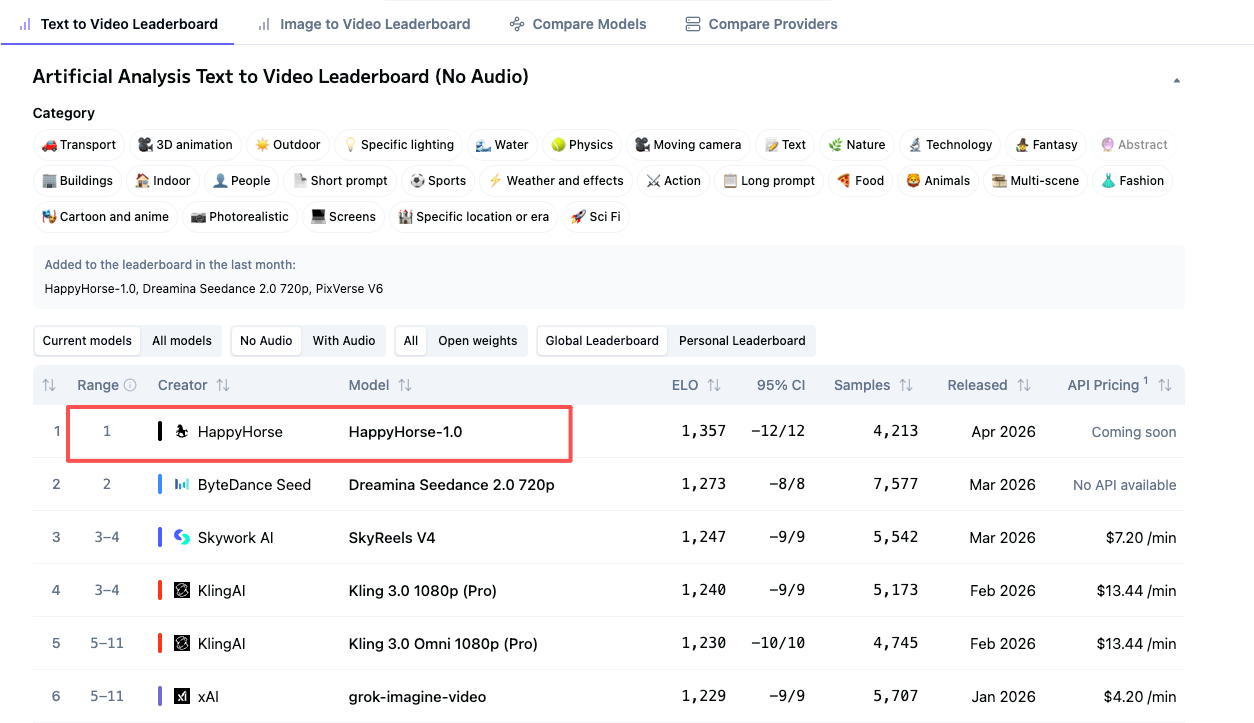

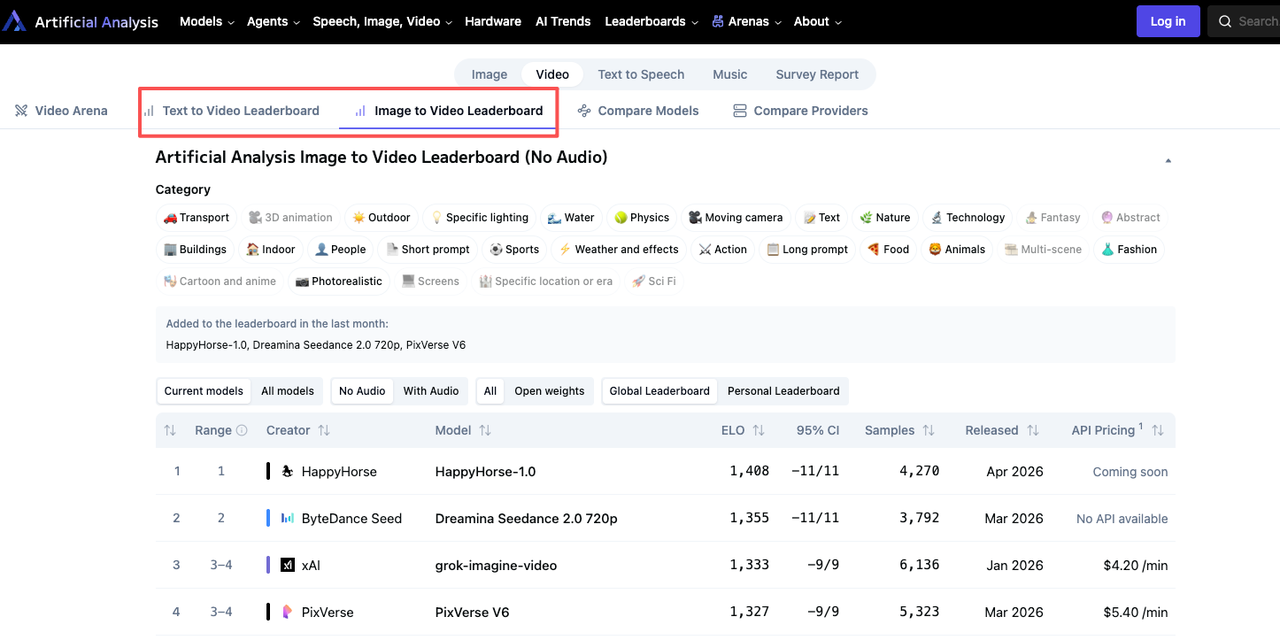

榜单战绩一览

| 赛道类别 | Elo分数 | 排名 | 此前霸主 |

|---|---|---|---|

| 文本转视频(无音频) | 1333-1357 | 🥇 第一 | Seedance 2.0(1273) |

| 图像转视频(无音频) | 1392-1402 | 🥇 第一 | Seedance 2.0(1355) |

| 文本转视频(含音频) | 1205-1215 | 🥈 第二 | Seedance 2.0(1219) |

| 图像转视频(含音频) | 1160 | 🥇 第一 | — |

最震撼的数据:在纯文本转视频赛道,Happy Horse比此前的"统治者"字节Seedance 2.0高出了60分Elo。在Elo评分体系中,这大约对应58%的盲测胜率——这是一个代差级的领先,意义远超普通的第一名。

三、事件始末:惊心动魄的72小时

第一夜:横空出世

2026年4月7日凌晨,Artificial Analysis Video Arena的榜单数据库中,突然多出了一条没有任何标识的匿名条目——HappyHorse-1.0。

Artificial Analysis是AI视频生成领域公认最权威的盲测平台,采用Elo评分系统,由真实用户在不知道模型名称的情况下投票打分。这种机制从根本上杜绝了厂商"自卖自夸"的可能,因此其排名被视为行业真实实力的风向标。

Happy Horse一上线,就以势不可挡的姿态横扫四个核心赛道。几个小时后,社交媒体上开始出现截图:有人发现,一个谁都没听说过的名字,居然把字节Seedance 2.0、Google Veo 3、OpenAI Sora 2全部压在身后。

风暴中心:全网"福尔摩斯"上线

消息传开后,全球AI技术社区瞬间沸腾。由于Happy Horse完全匿名,Twitter/X、Reddit、微博、Hacker News等平台上出现了大规模的"解密竞赛":

- "它是谁家的?" 成为最热话题

- 有人在Arena的匿名提交流程中找到线索

- 有人从模型的命名风格推断其亚洲血统

- 有人在GitHub和HuggingFace上搜索所有与"horse""happy"相关的AI项目

- 阿里港股因Happy Horse相关消息一度大涨近8%,资本市场率先给出了自己的判断

消失:悬念达到顶点

就在登顶后不到72小时内,Happy Horse的V1和V2两个版本从Artificial Analysis榜单上悄然撤下。官方页面随后上线,但所有下载链接——GitHub仓库、HuggingFace权重——均标注为"Coming Soon"。

留下了:

- 几张社交媒体上疯狂传播的截图

- 一个语焉不详的落地页

- 以及一个让整个行业辗转难眠的问题:它到底是谁?

四、技术深度解析:它凭什么碾压所有玩家?

尽管Happy Horse没有发布官方论文,但通过其官方落地页、第三方技术分析以及社区的深度挖掘,其技术架构已大致清晰。如果这些信息属实,Happy Horse代表着AI视频生成领域一次范式级的技术突破。

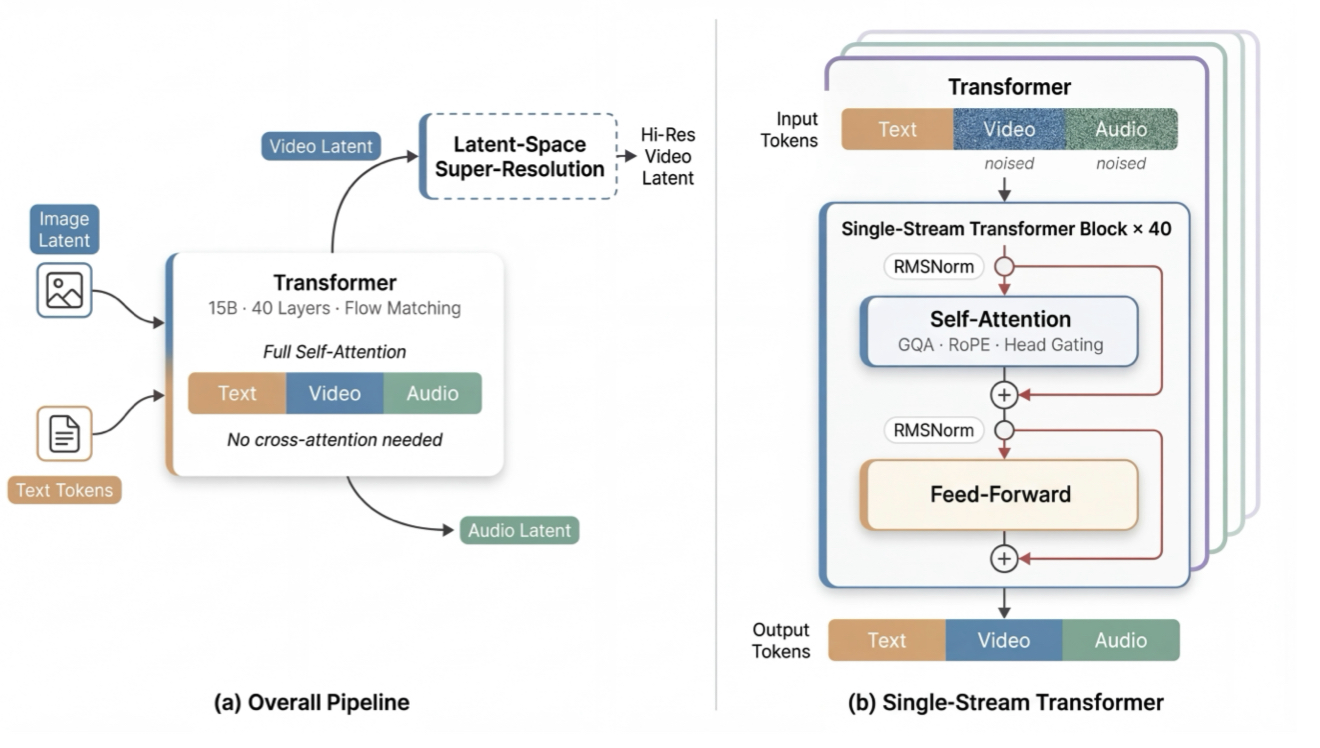

1. 架构革命:单流统一Transformer

目前主流的AI视频生成模型(如Sora、Seedance 2.0、Kling等)大多采用多流架构:

- 文本、视频、音频各自有独立的Encoder

- 通过Cross-Attention(跨注意力机制)互相交互

- 结构灵活,但参数冗余严重,推理时需要在多个分支之间反复搬运张量

Happy Horse的方案截然不同:

一颗40层Self-Attention Transformer,同时处理文本、视频和音频Token,中间没有任何Cross-Attention层,所有模态被统一编码进同一个序列,直接在同一个注意力空间里相互建模。

这是一种极其激进的架构选择:

- 首尾各4层:负责模态特定投影(输入编码/输出解码)

- 中间32层:参数完全共享,对所有模态一视同仁

- 没有Cross-Attention:多模态信息在注意力机制内部自然交互

这种"全Self-Attention单流"路线,正是GPT-4o、Gemini 2.x在多模态融合方向上一直在尝试的范式,但在视频生成领域,这是第一次以顶级性能、顶级Elo分数被验证。

2. 8步去噪 + 无CFG:极致的推理效率

对AI视频有所了解的朋友可能知道,当前主流模型普遍需要**几十步去噪 + CFG(无分类器自由引导)**才能产出高质量画面——这个过程耗时且计算密集。

Happy Horse的官方描述极为激进:仅需8步去噪,且不使用CFG,就能产出Arena排名第一的画质。

这通常意味着模型在训练阶段融合了一致性蒸馏(Consistency Distillation)、Rectified Flow或**渐进式蒸馏(Progressive Distillation)**等加速技术,将原本几十步的采样过程压缩成几步直接预测。

工程意义:更少的推理步骤 = 更低的延迟 = 更低的算力成本 = 更接近实时生成的可能。

3. 端到端音视频联合生成:真正的"一体化"

当前绝大多数AI视频模型的通用范式是:先生成画面,再单独处理音频——视频和音频是两套独立的管道,天然存在音画不同步的风险。

Happy Horse的杀手锏正在于此:在同一颗Transformer内部,同时处理视频Latent和音频Token,两者天然共享同一个生成空间。

这意味着:

- 音效、背景音乐、语音节奏全部一次性生成

- 唇形同步基于6种语言(中、英、日、韩、德、法)精细调校

- 视频和音频之间的协调性是模型内置约束,而非后期拼接

官方宣称,在H100 GPU上,生成一段5秒1080p带同步音频的视频,仅需约38秒。

4. 图像转视频:领先优势最大

在所有赛道中,Happy Horse在**图像转视频(Image-to-Video)**上的优势最为显著:

- 领先第二名Seedance 2.0超过50分Elo

- 在盲测体系中,这已经属于"用户能稳定感知到差异"的级别

这说明Happy Horse在"让静态照片动起来"这个维度上有着极其出色的能力,而这恰恰是虚拟人、数字主播、老照片修复等应用场景的核心需求。

五、竞品全方位对比:Happy Horse的优与劣

| 维度 | HappyHorse-1.0 | Seedance 2.0 | Kling 3.0 | Veo 3 | Wan 2.6 |

|---|---|---|---|---|---|

| 文本转视频排名 | 🥇 第1(Elo 1333) | 🥈 第2(Elo 1273) | 良好 | 强 | 良好 |

| 图像转视频排名 | 🥇 第1(Elo 1392) | 强 | 良好 | 强 | 良好 |

| 音频生成 | ✅ 同步音视频联合 | ✅ 音频独立 | ❌ | ✅ | ❌ |

| 多语言支持 | ✅ 6种语言原生 | 有限 | 有限 | 一般 | 有限 |

| 开源状态 | ✅ 承诺开源(待发布) | ❌ 闭源API | 部分 | ❌ 闭源 | 部分开源 |

| 运动质量 | ✅ 行业领先 | 强 | 良好 | 强 | 中 |

| 推理速度 | ✅ 快(8步/H100) | 中 | 快 | 中 | 中 |

| 唇形同步 | ✅ 6语言精准 | 强 | 一般 | 一般 | 一般 |

| 获取方式 | ❌ 尚未开放 | 即梦APP/API | 快手APP/API | Google API | 开源可部署 |

结论:Happy Horse是当前唯一同时具备"顶级视频质量 + 同步音频生成 + 多语言 + 承诺开源"四合一的模型。如果它的技术指标属实,综合竞争力已经超越了目前所有已商业化的闭源竞品。

六、身份谜团:幕后推手究竟是谁?

这是整个Happy Horse事件最引人入胜的悬念。截至目前,没有任何公司或团队公开认领,社区流传着三种主要猜测:

猜测一:阿里巴巴通义实验室(Wan 2.7马甲)⭐呼声最高

支持理由:

- 时间高度吻合:Happy Horse 4月7日登顶后不久,阿里通义实验室即发布Wan 2.6,业界普遍预期Wan 2.7即将到来

- 资本市场反应:港股阿里巴巴因Happy Horse消息一度大涨近8%,市场显然将两者关联

- CJK多语言能力:模型对中文、日语、韩语支持极为出色,这是华人/东亚团队的典型特征

- 发布风格:阿里此前在Qwen、Wan系列上多次采用"先小范围公开 / 再正式发布"的匿名打榜节奏

反驳声音:

- 阿里在4月正式发布的Wan 2.7与Happy Horse在官方描述上并不完全一致

- 技术架构描述有差异,两者更像是"同赛道两个产品"而非"同一模型的不同包装"

猜测二:字节跳动Seedance团队下一代变体

支持理由:

- Seedance 2.0是被Happy Horse直接超越的对象,字节有充足动机匿名测试下一代产品

- 字节在视频AI领域技术积累深厚,有能力短时间打造顶级模型

反驳声音:

- 如果是字节的更强版本,没有理由不用自己的名字

- Seedance 2.0在音频赛道仍领先Happy Horse,字节没有理由把"更强的版本"匿名上传

猜测三:全新华人独立团队"无包袱"出击

支持理由:

- "15B参数 + 全Self-Attention + 音视频联合"的激进技术栈,更像是一个没有历史包袱的新团队的选择

- 完全开源的承诺更接近研究型团队或初创公司的风格

反驳声音:

- 模型质量已经达到一线商用水平,纯学术团队很难独立完成如此规模的训练

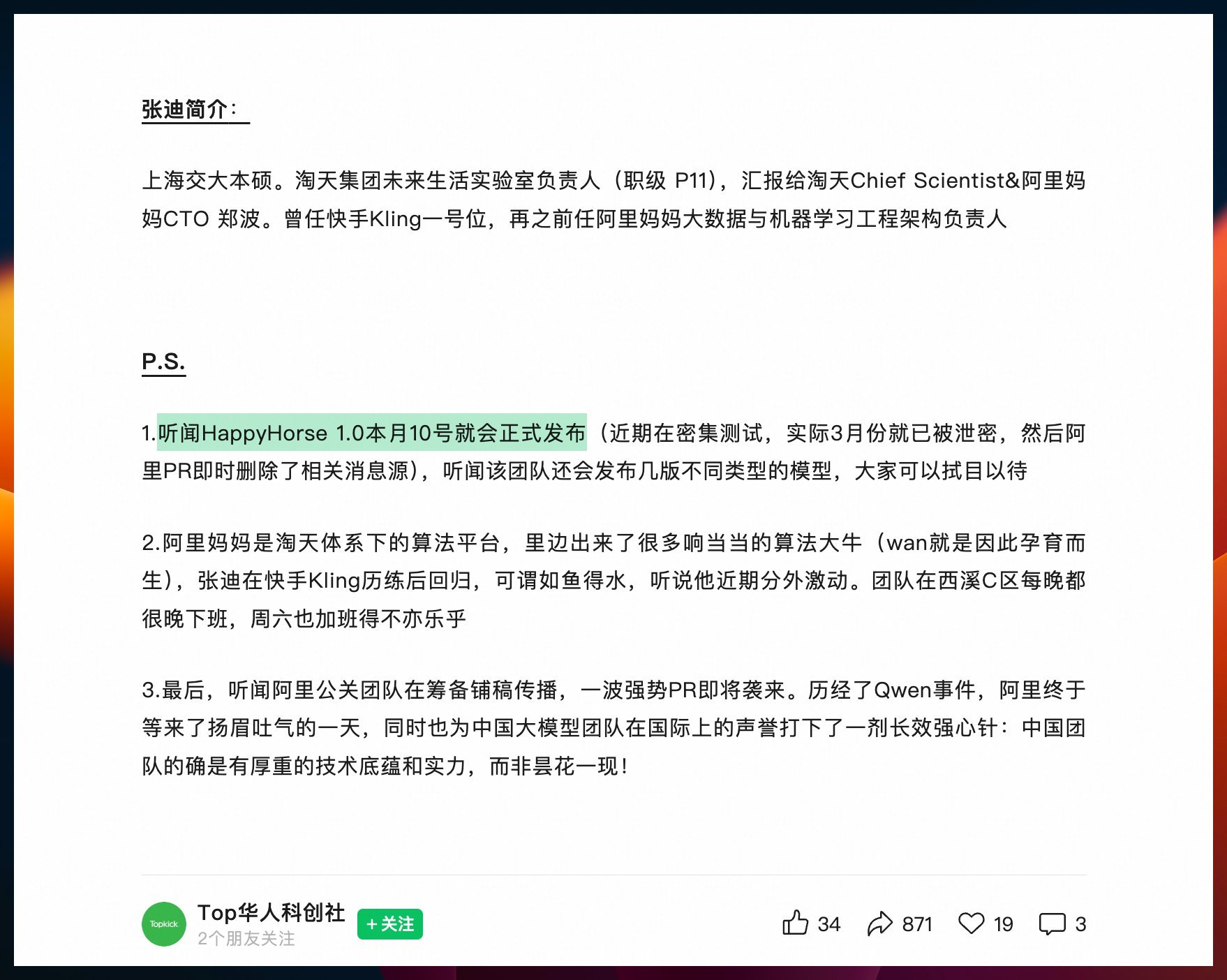

猜测四:淘天集团未来生活实验室(张迪团队)⚡

据科技垂直媒体**"Top华人科创社"在删除前的文章中披露,经多方求证,Happy Horse的幕后团队为淘天集团(Tmall)未来生活实验室**,项目领衔负责人为张迪。

支持理由:

- 淘天集团隶属阿里巴巴,拥有充足的算力资源和AI研发人才储备

- Happy Horse的多语言能力(中/英/日/韩)高度契合阿里电商出海的战略需求

- 开源策略与阿里"技术开放"的一贯路线相符

⚠️ 重要提示:该信源未经独立证实,且相关原文已被删除。此处仅作为补充信息列出,不代表本文确认此说法。在官方正式公布前,请以批判性眼光看待此信息。

理性看待:能力比身份更重要

在官方正式认领之前,所有猜测都只是推测,包括近期流出的"淘天集团未来生活实验室"说法(原文已删,信源待证)。值得关注的重点是:不是"它是谁",而是"它代表的能力上限已经到了哪里"。

一个有趣的历史规律:过去一年中,LMArena、Image Arena、Code Arena上多次出现"匿名模型 → 短暂登顶 → 悄然消失 → 几周后正式发布"的剧本——GPT-4 Turbo早期匿名版、Claude 3.5 Sonnet预览、Gemini 2.0 Flash早期变体都走过相同流程。

如果这一规律应验,Happy Horse很有可能在未来3-8周内以某个正式名字回归,届时我们或许就能知道真相。

七、行业影响:Happy Horse带来了什么?

即使Happy Horse最终没有正式发布,它已经在以下几个层面留下了深刻印记:

对头部厂商:打破"舒适区"

Seedance 2.0、Veo 3、Sora 2这些头部产品,在Happy Horse出现之前,彼此之间的Elo差距通常只有20-40分,属于"各有胜负"的均势格局。

Happy Horse的60分代差级领先,打破了这种平衡。它清晰地传递了一个信号:AI视频生成的能力上限,远未到达天花板。

这将迫使所有头部厂商加速技术迭代,尤其是:

- 音视频联合预训练(End-to-End Audio-Video Pretraining)

- 更激进的推理优化(减少去噪步数)

- 多语言原生支持

对开源生态:范式被验证可行

Happy Horse证明了"单流Transformer + 极少步推理"在视频生成领域不仅可行,还能做到SOTA(State of the Art,当前最强水平)。

这对于开源社区是重大利好:它意味着更多开发者可以在更低的算力门槛下,基于类似的架构进行二次开发。

对内容创作者:短剧、广告、教育赛道巨变

Happy Horse所展示的"多语言唇形同步 + 音频视频同步生成"能力,对于以下场景是革命性的:

- 🎬 AI短剧:批量生成多语言版本,降低出海内容制作成本

- 📢 跨境广告:一键生成中文/英文/日文配音的广告短片

- 🎓 在线教育:自动化生成带讲解画面的多语言课程内容

- 🎭 虚拟人/数字主播:让静态照片/头像生成带精准唇形的动态视频

对盲测榜单机制:信任危机?

Happy Horse的"匿名上榜 → 神秘消失"也给Artificial Analysis等盲测平台敲响了警钟:匿名条目越来越多,如何区分"真新模型"与"已有模型的某个Checkpoint"?

对于开发者而言,这意味着未来阅读Elo排行榜时,需要更多结合实际业务数据和模型文档,而不是盲目相信单一数字。

八、实用指南:当下能用什么?

坏消息:Happy Horse目前无法使用,GitHub和HuggingFace均标注为"Coming Soon"。

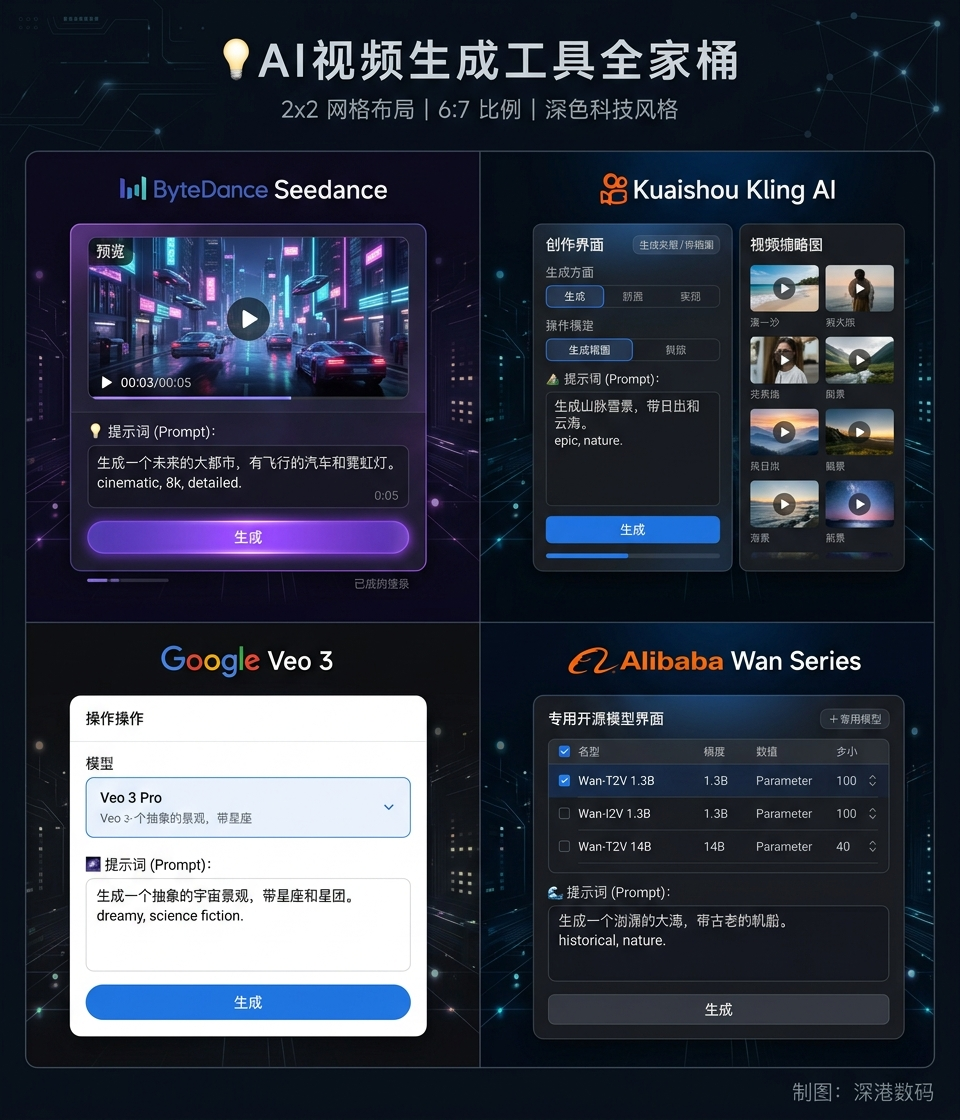

好消息:以下模型目前已经开放,在Happy Horse真正到来之前,它们完全可以覆盖绝大多数实际生产场景:

| 模型 | 推荐理由 | 适用场景 |

|---|---|---|

| Seedance 2.0 | 中文场景强,音频能力强 | 短剧出海、广告配音 |

| Kling 3.0 | 人像/动作表现优秀 | 虚拟人、数字主播 |

| Veo 3 | 通用质量第一梯队 | 品牌内容、电影预制 |

| Wan 2.6 | 开源可本地部署 | 研究、自托管、定制化 |

| Sora 2 | 镜头语言出色 | 电影化内容、高端制作 |

实用建议:

- 工具链中立:建议通过统一的API平台(如API易等)接入多家视频模型,避免被单一厂商绑定

- 建立内部基准:用自己真实的业务Prompt和素材,形成独立的"内部测试集"

- 快速切换能力:一旦Happy Horse正式开放,只需切换model参数,无需重写代码

九、总结与延伸思考

核心结论

Happy Horse-1.0是2026年AI视频生成领域最具戏剧性的一次"匿名空降"。它用72小时的榜单霸权,留给了行业三件事:

- 能力天花板再次被刷新:60分Elo的代差级领先,说明当前我们看到的"最强视频模型"远未到终点

- 音视频联合生成已成新主战场:端到端的audio-video pretraining,将是所有玩家的下一个必争之地

- 匿名 → 撤回 → 正式发布,正在成为旗舰模型的发布新范式

延伸思考:开源的终极对决

Happy Horse事件的另一个深层意义在于——它提出了一个关乎行业未来的根本问题:

当开源模型能够匹敌甚至超越闭源商业模型时,闭源厂商的护城河还剩什么?

Seedance 2.0有字节的流量入口和商业化体系,Sora有OpenAI的品牌光环,但如果Happy Horse最终如约开源,配备同样强大能力的开放权重,全球开发者社区的二次开发和优化速度,可能远超任何一家公司的内部迭代。

2026年的AI视频生成,精彩才刚刚开始。

推荐阅读

- 折叠屏 iPhone 来了:苹果迟到六年的"折叠革命",凭什么可以搅动整个行业?

- 解析奥拉丁Origin :百亿资金盘雪崩纪录

- 一场波及上百万账号的密码危机,我们还能信任 iCloud 吗?

- 2026年AI大模型盘点:群雄逐鹿,谁主沉浮?

- Seedance 2:AI视频生成的"字节核弹",如何搅动了整个好莱坞

- 麻豆传媒关停:那个曾祸害无数少女的"华人第一厂牌",彻底凉了

- 反诈老陈:从1.2亿人围观的"反诈网红"到账号被封的起伏人生

- 周杰伦2026新专辑《太阳之子》:出道25年的“自我致敬”还是“情怀收割”?

- 小米MIUI正式停更:一个时代落幕,15年经典画上句号

- 暗讽张雪峰的大V“留几手”:一个网红的十年坠落样本

- 张雪机车:从北碚山火到WSBK世界之巅,一个草根的逆袭与争议

- 苹果2026年新品爆发:超15款产品蓄势待发

- 深入解析 Claude Code 泄露版源码:我学到了这些 Agent 架构精髓!

- 单依纯:从「好声音」冠军到华语乐坛新势力的五年进击路

本文作者:KK

本文链接:

版权声明:本博客所有文章除特别声明外,均采用 BY-NC-SA 许可协议。转载请注明出处!